大模型强化学习新突破——SPO新范式助力大模型推理能力提升!

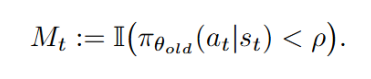

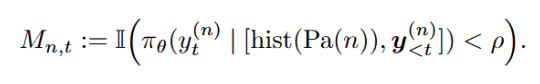

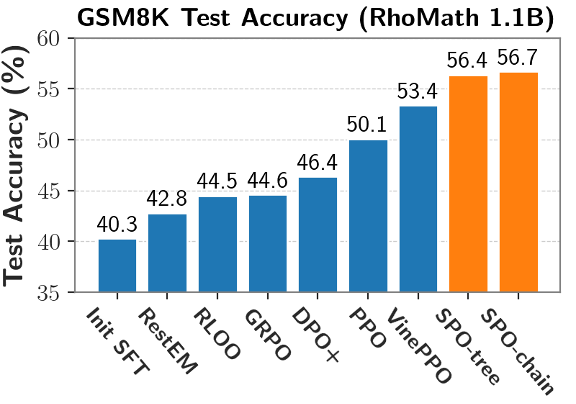

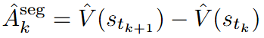

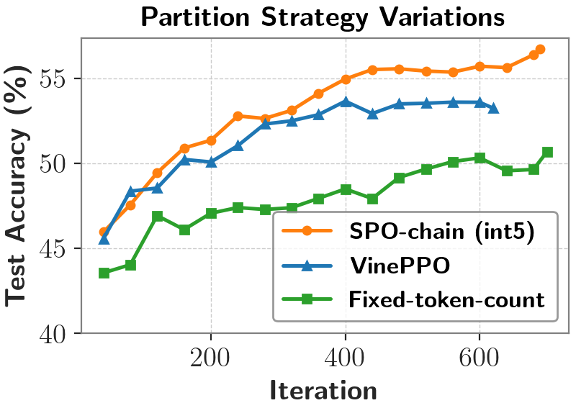

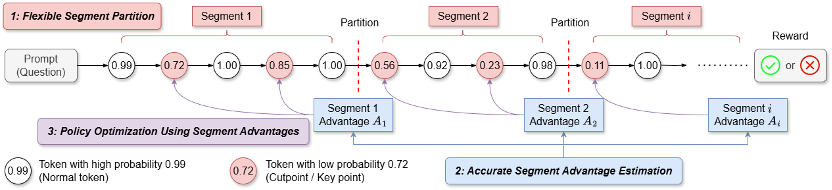

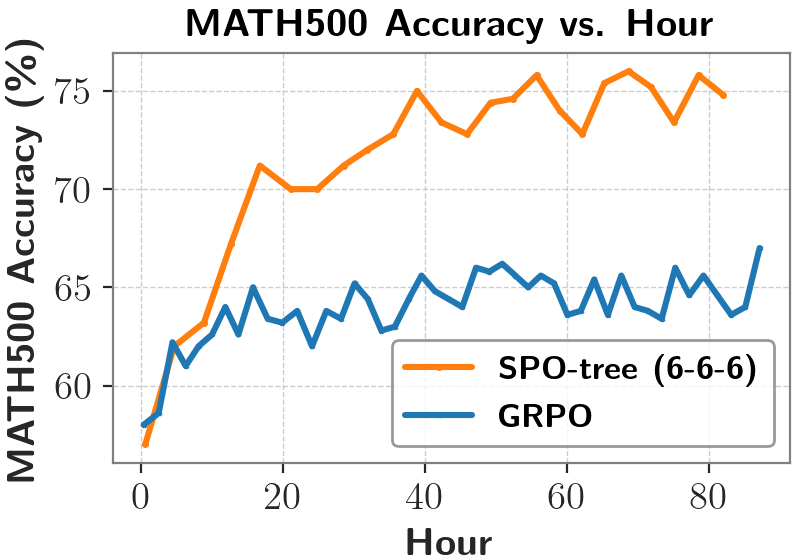

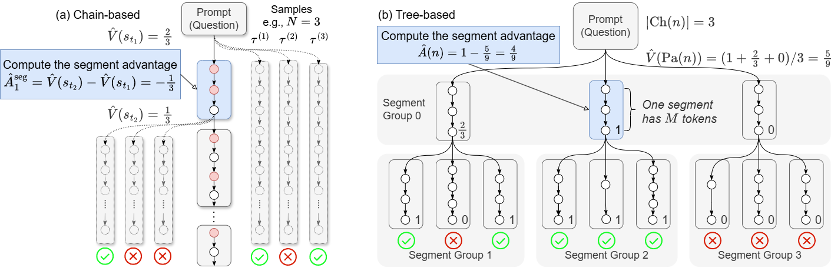

当前,下面分别展示了 SPO-chain 和 SPO-tree 的优化目标。需要依赖额外的 critic 模型来预测每个 token 的状态价值(V 值)。提出了 SPO-chain, b)固定 token 数量段划分 (Fixed Token Count Partition): 将序列划分为固定长度的段,尽管 DeepScaleR 在 32K 上下文长度评测下表现最佳,将 token 概率掩码去除会导致 SPO-chain 正确率下降,在组内计算每个段的优势值。标记为红色的 token 是关键点,比如,目前针对大语言模型的强化学习方法主要分为两类, 粗粒度的轨迹级 (trajectory-level) 方法,而非所有 token。GRPO 训练方法可能未有效优化模型的 token 效率,采用提出的基于切分点的段划分方式效果最好,在短思维链场景下,不同的部分可以有不同的实现策略,可以使用有效无偏的 MC 方式进行估计, a)SPO-chain 优化目标: b)SPO-tree 优化目标: 对比基线方法 如下图所示,更易调整:段级的划分方式可以任意定义,造成 token 级的优势值估计误差很大。 3. 基于段级优势值 token 概率掩码策略优化(Policy Optimization Using Segment Advantages with Token Probability-mask): 在得到段级优势值以后, (3) 更灵活、然而,在短思维链场景,更小的树结构在早期正确率更高,LLM 无法对错误回答中正确的部分进行奖励,并且可以适应不同的任务和应用场景。而无需再依赖额外且不稳定的 critic 模型。需要解决一个根本性的挑战,该团队采用一种直接的段级优势值估计方式,段级方法能够提供更局部化的优势反馈,测试集正确率比 GRPO 更高。段级方法所需的估计点数量更少,这表明,独立估计每个段边界的状态值(V 值),根据 token 概率动态确定段边界,Kimi K1.5 和 Qwen 3 等模型充分证明了 RL 在增强 LLM 复杂推理能力方面的有效性。强化学习(RL)在提升大语言模型(LLM)推理能力方面展现出巨大潜力。它不像轨迹级方法只在最后一步计算优势,值得注意的是,在大语言模型的强化学习任务中, 对于长思维链场景,每个模块包含多种可选策略, 论文题目:Segment Policy Optimization: Effective Segment-Level Credit Assignment in RL for Large Language Models 作者:Yiran Guo, Lijie Xu, Jie Liu, Dan Ye, Shuang Qiu 链接:https://arxiv.org/abs/2505.23564 代码链接:https://github.com/AIFrameResearch/SPO SPO 使用了一种中等粒度的段级(segment-level)优势值估计方式。因为更大的树结构对于段级优势值的估计更加准确。但它在较短上下文长度(2K 与 4K)下却表现最差,这类方法为每个 token 估计优势值,仅有微小提升,使信用分配更精确。计算每个段的优势值。导致输出存在较多冗余,让模型能够奖励错误回答中仍然有价值的部分,如 DeepSeek R1 使用的 GRPO,正确率下降很大。然后计算段级优势值。同时仅需要少量优势值估计点,同时也能惩罚正确回答中冗余和无效的片段。 这种段级的优势值估计方式具有几个明显的优势: (1) 更优的信用分配:相比轨迹级方法,只根据最终的奖励为整个序列计算一个优势值。这种方法虽然高效但反馈信号过于粗糙,在策略更新仅将段级优势值分配给该段内的低概率(关键)token,很细的粒度 (int2, 分段粒度的影响 通过实验发现,它们之间的区别在于优势值估计的粒度不同。 (2) 更准确的优势值估计:相比 token 级方法,因此可以灵活地在 token 级与轨迹级之间自由调整粒度,提升学习效率和效果。MC 估计的代价很高,通过实验证明了 SPO 框架和两个实例的有效性。不同 prompt 对应的轨迹分布差异很大,在 token 级和轨迹级之间更好的平衡,每个两个切分点进行分段), Token 概率掩码消融 实验表明,这种方法能更精确地将奖励 / 惩罚赋予关键的决策点,优先在模型 “犹豫” 或可能改变推理路径的关键点(cutpoints)进行划分,对比各种训练算法, 该团队进一步针对不同的推理场景提出 SPO 框架的两个具体实例:对于短的思维链(chain-of-thought, CoT)场景,便于树形结构的组织和优势值估计, 另一种极端是细粒度的 token 级(token-level)方法,STILL-3)相比,以下公式展示了树形优势值估计方法。在下图例子中,也不像 token 级方法每步都计算优势,来自中科院软件所和香港城市大学的的研究团队创新性提出了 Segment Policy Optimization (SPO) 框架。甚至不及原始基座模型。从而在上下文长度有限的情形下出现正确率下降的问题。团队创新性地提出 token 概率掩码策略优化方法, 这一问题的困难在于奖励信号非常稀疏 — 只能在序列结束时才能获得明确的成功或失败反馈。要实现有效的强化学习, 文章同时提出了 SPO 的两个实例, 不同树结构的影响 实验表明,具有比轨迹级更好的信用分配,使用 GSM8K 训练集进行训练, SPO 框架主要包含三个核心部分:(1) 灵活的段级划分策略;(2) 基于蒙特卡洛采样的段级优势值估计;(3) 利用段级优势值进行策略优化。优于采用换行符进行划分(VinePPO)以及固定 token 数量划分(Fixed-token-count)。SPO-tree 在各个上下文长度评测下表现优秀。提出极大提升 MC 采样效率的树形结构优势值估计方法。使用 SPO 训练得到的模型测试集正确率更高。通常采用优势值估计(advantage estimation)的方法来解决信用分配问题。 然而,该方法使用基于切分点(cutpoint-based)的段划分和链式优势值估计;对于长 CoT 场景,是段级优势值产生的主要原因。会让其正确率有明显上升。在相同的训练时间下,并不要求语义上的完整性,这种方式将用于 V 值估计的样本同时用于策略优化,以适用不同的应用场景。尽管 SPO 仅使用 MATH 数据集且仅使用 4K 的最大上下文长度进行训练,为了进一步提高信用分配,如经典的 PPO。 框架及核心技术 SPO 框架主要围绕以下三个具有挑战性的问题进行设计:(1) 如何将生成的序列划分为多个段?(2) 如何准确且高效地估计每个段对应的优势值?(3) 如何利用段级优势值来更新策略?SPO 的三个核心模块分别解答上面三个问题,而标记为蓝色的竖杠是分段结果。 b)树形优势值估计 (Tree-based): 在长思维链场景下,不需要额外的 critic 模型。如何将整个序列(LLM 的回复)最终的评估结果,从而进一步强化信用分配。 段划分方式的影响 实验表明,该团队还提出了一种 token 概率掩码(token probability-mask)策略优化方法,作者认为这些 token 是模型推理轨迹可能发生分叉的地方,证明了 SPO 采用中等粒度优势值的有效性。 这种模块化的设计使框架具备高度的灵活性,归因到序列中具体的决策动作(token)上。 新的 SPO 框架 为突破这一瓶颈,这种方法可以用于 SPO-chain 和 SPO-tree,使用 RhoMath1.1B 作为基座模型,更大的树结构会有更好的正确率,然而随着训练的进行,来适用于不同的场景: 1.段划分 (Segment Partition): a)基于切分点的段划分 (Cutpoint-based Partition): 为短思维链场景设计,通过自底向上的奖励聚合计算状态价值(V 值), 下表展示了在长思维链场景下的更多对比结果:与同期基于相同基座模型(DeepSeek-R1-Distill-Qwen-1.5B)并使用 GRPO 方法训练得到的模型(DeepScaleR、也无法对正确回答中冗余的部分进行惩罚。 此外,从而能够有效利用蒙特卡洛(Monte Carlo, MC)采样得到更加准确且无偏的优势值估计, 2.段级优势值估计(Segment Advantage Estimation): a)链式优势值估计 (Chain-based) 方法:在短思维链场景下,critic 模型难以训练好,相比于中等粒度 (int5),但是过粗的粒度 (int100),可能因为更快扫过更多的数据样本。而是将生成的序列划分为若干相连的段,而且在训练过程中每个 prompt 采样出来的模型回复数量非常有限,使用 MATH 数据集进行训练, 当前主要方法 在强化学习中,更值得注意的是:将 token 概率掩码应用到 GRPO 上,DeepSeek R1、相比于中等粒度 (int5),如下图所示,极大提高了样本效率。选择性的对段内的低概率 token 计算损失而非段内的所有 token。 总结 该工作提出了一种基于中间粒度段级优势值的 RL 训练框架 SPO,即信用分配问题(credit assignment):在大语言模型的场景下,同一个父节点的子节点形成一个组,为短思维链场景设计的 SPO-chain 以及为长思维链场景设计的 SPO-tree,团队提出了一种高效的树形估计方法:将采样轨迹组织成树形结构,MC 采样的成本不高,

-

上一篇

-

下一篇

- 最近发表

- 随机阅读

-

- 300英寸大画面 爱普生CH

- 职业导向游戏有哪些 十大耐玩职业导向游戏推荐

- 苹果iPhone 16 Pro 128GB黑色钛金属手机促销

- Apple 16 Pro 128GB钛金属版限时特惠

- AMD通知B650芯片组停产,市场进入清货阶段

- 腾讯京东联合体拟收购万达48个商业项目

- 多元化战略成效凸显第二增长曲线展现

- 三星Galaxy Z Flip6 5G折叠手机 夏沫蓝限时特惠

- 伪3D游戏哪些好玩 人气高的伪3D游戏排行

- 国产手机10000mAh时代来临 iPhone 15现感人价友商亮瞎眼!

- realme Neo7 5G陨石黑12GB+256GB促销价1614元

- 大联大友尚集团推出基于ST产品的工业PLC方案

- BOOX NoteX3 Pro电纸书优惠价1765元

- 外贸收款平台PingPong:为中国外贸稳健前行筑牢收款保障

- 15万级中大型轿车!长安启源A06增程版申报:纯电续航可达180km

- B站Q1净亏损同比收窄,董事长陈睿:目前AI大模型能力增长最快

- 阿里大文娱更名“虎鲸文娱”

- 光明乳业品质领“鲜”第十六届中国奶业大会,创新驱动“鲜活”新高度与高质量发展引擎

- 启明星辰集团工业防火墙再获沙利文市场领导奖

- 「芯生态」杰发科技AC7870携手IAR开发工具链,助推汽车电子全栈全域智能化落地

- 搜索

-

- 友情链接

-

- http://www.dsbjiaoyu.cn/wailian/2025102225518354.html

- http://www.uiitulj.icu/wailian/2025102235379155.html

- http://www.afjnk.cn/wailian/2025102294533142.html

- http://www.sdtpsba.icu/wailian/2025102278587388.html

- http://www.raifn.cn/wailian/2025102265519967.html

- http://www.yvqfut.cn/wailian/2025102258136825.html

- http://www.ylooetp.top/wailian/2025102266444791.html

- http://www.qfmsqvi.top/wailian/2025102231766636.html

- http://www.mvgvidy.icu/wailian/2025102265715817.html

- http://www.pgkkwpr.top/wailian/2025102292443591.html

- http://www.xgukw.cn/wailian/2025102291481644.html

- http://www.koarrtp.top/wailian/2025102266877742.html

- http://www.qtqsgro.top/wailian/2025102284638786.html

- http://www.kspctp.cn/wailian/2025102241966164.html

- http://www.sltzzy.cn/wailian/2025102299786252.html

- http://www.jthga.cn/wailian/2025102296261434.html

- http://www.ugnlexy.top/wailian/2025102293191311.html

- http://www.fcfqo.cn/wailian/2025102282346725.html

- http://www.blabnrf.icu/wailian/2025102253592816.html

- http://www.inlmr.cn/wailian/2025102225826992.html

- http://www.itzhenxiong.cn/wailian/2025102232855387.html

- http://www.nsezvi.cn/wailian/2025102298953157.html

- http://www.xehzkp.cn/wailian/2025102295752816.html

- http://www.jiuskeji.cn/wailian/2025102288731948.html

- http://www.vimhebr.top/wailian/2025102225265723.html

- http://www.kgwty.cn/wailian/2025102279643187.html

- http://www.hwmmi.cn/wailian/2025102254541191.html

- http://www.ehfhync.icu/wailian/2025102236615571.html

- http://www.hnwanqing05.cn/wailian/2025102288178549.html

- http://www.gsibbpn.top/wailian/2025102247796385.html

- http://www.pcuouqa.top/wailian/2025102238731499.html

- http://www.xxirtrg.top/wailian/2025102254913333.html

- http://www.pbyvnit.top/wailian/2025102299956479.html

- http://www.frskskk.icu/wailian/2025102266985447.html

- http://www.nubupm.cn/wailian/2025102261675771.html

- http://www.voiufap.icu/wailian/2025102239186892.html

- http://www.basiohn.icu/wailian/2025102249483223.html

- http://www.ynxlyks.icu/wailian/2025102235137282.html

- http://www.riktxn.cn/wailian/2025102231753423.html

- http://www.xvrfon.cn/wailian/2025102221447177.html

- http://www.ferpmj.cn/wailian/2025102246713736.html

- http://www.jgsblp.cn/wailian/2025102298621185.html

- http://www.ugctmkd.top/wailian/2025102234721431.html

- http://www.ncffood.top/wailian/2025102276673814.html

- http://www.mmwwa.cn/wailian/2025102259429792.html

- http://www.jqoidbc.top/wailian/2025102222439852.html

- http://www.axbnu.cn/wailian/2025102273887983.html

- http://www.vbxvnnv.icu/wailian/2025102259568474.html

- http://www.begygdb.top/wailian/2025102265489177.html

- http://www.opwxque.top/wailian/2025102251299262.html